OpenAI, GPT dil modelinin en son sürümü olan GPT-4‘ü duyurdu. Yeni sürümün ana yeniliği, metin ve görüntülerin girdi olarak kullanılabilecek. Ayrıca GPT dil modeli, ChatGPT ve yeni Bing gibi yapay zekalı sohbet robotlarının temelini oluşturuyor.

OpenAI, GPT-4’ün çıktı olarak metin üretmek için görüntüleri ve metni kabul ettiğini vurguluyor. Şirkete göre, yeni model birçok gerçek dünya durumunda insanlardan daha az yetenekli, ancak GPT-4 çeşitli profesyonel ve akademik kıyaslamalarda insan düzeyinde performans gösteriyor.

Ayrıca bkz: WhatsApp Business Uygulaması Yeni Özellikler Kazanıyor

Selefi GPT-3.5, girdi olarak yalnızca metin kabul ediyor. Normal, gündelik bir konuşmada GPT-3.5 ve GPT-4.0 arasındaki farklar ince olabilir. OpenAI, farklılıkların ancak görev belirli bir karmaşıklık düzeyine ulaştığında veya bu düzeyi aştığında gerçekten belirgin hale geldiğini belirtmektedir. GPT-4’ün GPT-3.5’e kıyasla daha güvenilir, yaratıcı ve daha incelikli talimatları yerine getirebildiği söyleniyor.

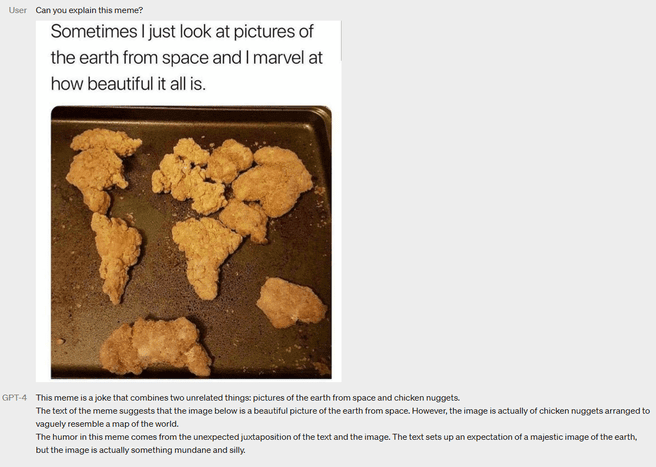

OpenAI, ekli bir resim hakkında metin içinde bir soru sorulduğunda GPT-4’ün yeteneklerinin birkaç örneğini gösteriyor. Örneğin, modelden resimle ilgili komik olan şeyin ne olduğunu açıklamasının istendiği birkaç örnek vardır.

OpenAI’ye göre, en son sürümün performansını iyileştirmek için altı ay harcandı. Bir yıl önce GPT-3.5, yeni sistem için ilk test oturumu olarak eğitildi. Bu süreçte hatalar ve teorik temeller iyileştirildi. OpenAI, bu temelde GPT-4 test oturumunun “benzeri görülmemiş derecede istikrarlı” olduğunu söylüyor. Şirkete göre bu yeni sürüm, eğitim performansı doğru ve erken tahmin edilebilen ilk OpenAI dil modeli oldu.

GPT-4’ün metin giriş kapasitesi ChatGPT ve yeni modelin api’si aracılığıyla yayınlanacak ve bunun için bir bekleme listesi var. Görüntü giriş kapasitesini daha yaygın bir şekilde kullanılabilir hale getirmek için OpenAI şimdilik tek bir ortakla, yani Be My Eyes ile çalışıyor. Bu, dünyayı körler ve görme engelliler için daha erişilebilir hale getirmeyi amaçlayan bir mobil uygulama.